Digitalni tragovi i AI – temelji nove metodologije u društvenim znanostima (III dio)

Desetljećima je metodološki krajolik društvenih istraživanja bio relativno stabilan, izgrađen na čvrstim temeljima anketnih upitnika, strukturiranih intervjua i udobnosti (point-and-click) padajućih izbornika statističkog softvera[1]. A onda su se dogodile dvije stvari, istovremeno! Prvo, milijarde ljudi počele su ostavljati digitalne tragove posvuda. Svaki klik, svako pretraživanje, svaki like, svaka geolokacija s mobilnog telefona, počeli su se bilježiti! Odjednom smo dobili digitalni otisak ljudskog ponašanja u stvarnom vremenu, na mikro-razini, ali makro-opsegu. Drugo, duboka, egzistencijalna (i sramotna!) replikacijska kriza potresla je društvene znanosti[2]. Pojedine uvažene studije, često iz udžbenika, nisu se mogle ponoviti. To je dovelo do kolektivne spoznaje da su u pojedinim istraživanjima korištene metode bile neprimjerene, rezultati upitni, a trening istraživača neadekvatan. Stvoren je hitan, gotovo egzistencijalni pritisak za transparentnošću. Taj dvostruki pritisak rodno je mjesto računalnih društvenih znanosti (computational social science, CSS), koje su se etablirale kao samostalna disciplina unutar društvenih znanosti, a ne logičnom evolucijom u njih ugradile. Ključno je pritom shvatiti da CSS nije samo “kvantitativna sociologija s podacima s Twittera”. Razlika je fundamentalna, gotovo epistemološka. Stare metode društvenih znanosti stvorene su za udobni svijet strukturiranih podataka, jasnih redaka i stupaca, dok se nove temelje na „divljim“, i nestrukturiranim podacima, na „relacijskom neredu“.

Alati koji su iznikli kao odgovor na ovu novu stvarnost nisu tek torba prepuna novih trikova, već integrirani ekosustav. Oni se intuitivno, i bez prekomjerne redukcije, mogu svrstati u dva glavna tabora. Alati za transparentnost, koji predstavljaju odgovor na replikacijsku krizu i uključuju programske jezike (Python, R, Juila, Rust), Git+GiHub i Docker. Promatrano iz aspekta društvenih znanosti, oni su tu da cijeli istraživački proces učine reverzibilnim, suradničkim i ponovljivim. Alati za razmjer (skalu) označavaju odgovor na novonastalu, veliku količinu podataka i uključuju webscraping, NoSQL baze podataka, strojno učenje i njegove napredne ekstenzije, NLP , Spark i sl. Oni omogućuju prikupljanje, upravljanje i analiziranje podataka na skali o kojoj smo prije mogli samo sanjati.

Umjetna inteligencija, a poglavito napredak u velikim jezičnim modelima (LLM), u ovu se arhitekturu ne uklapa nužno kao zaseban, treći tabor, već kao vezivno tkivo koje prožima i nadograđuje oba prethodna. Ona djeluje kao katalizator koji dokida barijere ulaska u ovaj tehnički zahtjevan ekosustav. S jedne strane, AI demokratizira alate za transparentnost pišući i objašnjavajući kôd istraživačima koji nisu primarno programeri, dok s druge strane, alatima za razmjer dodaje interpretativnu dubinu. Dok su raniji alati omogućili obradu milijuna redaka podataka, AI omogućuje da se ti podaci ne samo zbroje, već i pročitaju, sintetiziraju i kontekstualiziraju brzinom koja je ljudskom umu nedostižna. Time se fokus istraživača pomiče s manualnog upravljanja sintaksom i bazama podataka na postavljanje kvalitetnijih pitanja i kritičku evaluaciju strojnih uvida.

Ulaznica u novi svijet društvenih analiza

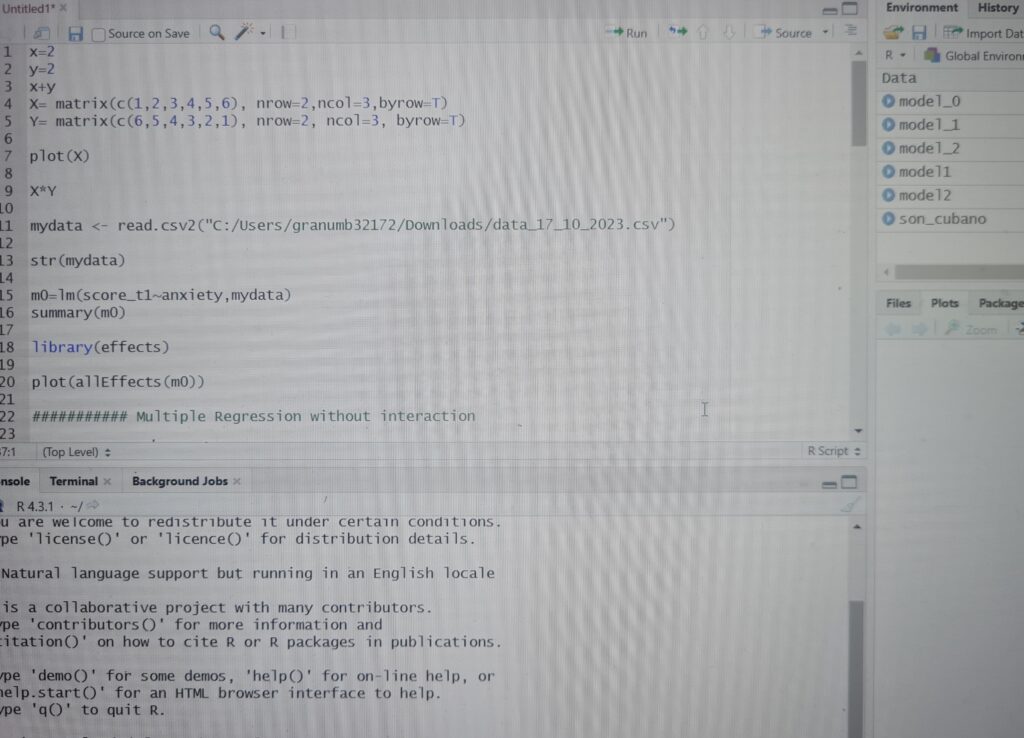

Računalni skup alata (vještina) počinje s onim što mnoge prestravljuje: terminal (shell). To je onaj crni prozor sa zastrašujućim, trepćućim kursorom. Moramo zamijeniti udobni električni automatik (GUI) za neugodni stari terenac s ručnim mjenjačem (CLI). Zašto? Terminal je ulaz u ozbiljan računalni rad iz tri razloga: automatizira zadatke (npr. obradu 1000 datoteka odjednom), povezuje sve ostale alate i, što je najvažnije, jedini je način za pristup računalnim serverima. Ne možete klikati po superračunalu! Pristup računalnim klasterima visokih performansi (HPC) ili Googleovim serverima ide isključivo kroz terminal. Pravi utjecaj ovdje nije tehnički, nego mentalni. Prelazite iz pasivnog korisnika unaprijed definiranog softvera u aktivnog operatera sustava. Ako je terminal ulaz, onda je sintaksa programskog jezika (Python ili R) lingua franca koju unutra svi govore.

Divlji zapad podataka

S tim alatima u rukama, izlazimo na bojno polje prikupljanja podataka. Struganje weba (webscraping) omogućuje da vidimo što ljudi stvarno rade, a ne samo ono što kažu da rade u anketama. Politolozi mogu strugati saborske govore, ekonomisti pratiti cijene s web-shopova u stvarnom vremenu….no, ovo je postalo bojno polje! Klasično serversko struganje (preuzimanje podataka sa statične HTML stranice) često je istraživačima jedini način prikupljanja podataka u svijetu u kojem korporacije te iste podatke vide kao privatno vlasništvo i aktivno ih privatiziraju (https://snurb.info/files/2019/After%20the%20%27APIcalypse%27.pdf). Taj novi, nestrukturirani podatkovni plijen ne može se spremiti u stare .csv (flat) datoteke. Ovdje društveni znanstvenici moraju postati upravitelji podacima, razumijevajući dvije paradigme. SQL baze (strukturirane) su poput savršeno organiziranog ormara za spise, idealne za goleme, strukturirane administrativne podatke ili popise stanovništva. NoSQL baze (nestrukturirane) su, s druge strane, dizajnirane da za prihvat neurednih, polustrukturiranih, i ugniježđenih podataka (poput JSON datoteka).

Kroćenje zvijeri

Jednom kada je plijen uhvaćen, počinje pravi posao čišćenja podataka (data wrangling), na koji odlazi većina (~ 80%) posla sa podatcima. Standardni paketi za to su pandas i numpy u Pythonu i tidyverse i data.table u R-u. Istraživač ima potrebu za svim navedenima, jer svaki ima svoju nezaobilaznu svrhu. Da bismo izbjegli katastrofalne (copy-paste) pogreške koje uništavaju istraživanja (kad kopirate 20 redaka koda i zaboravite promijeniti jednu varijablu), prestajemo pisati linearne skripte i počinjemo pisati funkcije. Time društveni znanstvenici postaju (junior) programeri. Funkcija je apstrakcija: logika se piše jednom, testira, a zatim primjenjuje stotinu puta. To je jedini način za upravljanje kognitivnom složenošću modernog CSS projekta. Neizbježno, standardno (vulgaris) stolno računalo u nekom trenutku više nije dovoljno. Tu nastupa skaliranje. Prvi korak je paralelno programiranje, umjesto korištenja jedne procesorske jezgre, angažiramo sve što imamo odjednom. No, za ozbiljnije izazove, tu je trijada koja efektivno uklanja sva računalna ograničenja društvenoj znanosti: HPC (superračunalo), Spark i Cloud (GCE/AWS).

Čuvari istine

Time se vraćamo na početak, na krizu. Sva ova računalna moć je beskorisna, čak i opasna, ako stvara nove, još kompleksnije crne kutije znanosti. Zato je posljednji sloj alata posvećen vjerodostojnosti. Git/GitHub rješava kaos stvaranjem transparentnog i nepromjenjivog dnevnika svake promjene u kodu. To je platforma za otvorenu znanost. Objavljeni članak u časopisu sada zapravo postaje samo reklama za pravi znanstveni artefakt, GitHub repozitorij. A onda, tu je Docker (kontejner), sveti gral ponovljivosti. On rješava onu rečenicu u znanosti: “Pa, kod mene radi.” Recenzent preuzme vaš savršeni kod. Ne radi. Zašto? On ima R verziju 4.3, vi ste imali 3.6. Jedan ključni paket se ažurirao. On je na Windowsu, vi ste bili na Linuxu. Vaše istraživanje nije ponovljivo. Docker je rješenje. Docker ne pakira samo vaš kod, on pakira cijelo računalno okruženje, operativni sustav, točnu verziju programskog jezika, točne verzije svih paketa… Pomoću Dockera dijelimo digitalnu vremensku kapsulu analize. Recenzent ga pokrene i dobiva identične rezultate. To je ultimativni tehnički odgovor na replikacijsku krizu.

Sintetička inteligencija

Gdje se u ovaj strogi, inženjerski svijet terminala i kontejnera uklapa umjetna inteligencija (AI)? Ona nije tek još jedan alat u kutiji, poput čekića ili odvijača. Umjetna inteligencija je promjena agregatnog stanja cijelog sustava. Do sada je najveća prepreka računalnim društvenim znanostima bila strma krivulja učenja. Za komunikologa ili politologa, prijelaz s klasičnog (dropdown) softverskogsučelja na pisanje Python funkcija u terminalu izgledao je kao uspon na Everest. AI, posebice veliki jezični modeli (LLM), ovdje djeluju kao sintetički mentor. Oni demokratiziraju pristup računalnoj moći jer prevode prirodni jezik (ono što istraživač želi) u sintaksu koda (ono što stroj razumije). S AI asistentom, svaki istraživač dobiva (senior) developera koji sjedi pored njega, piše (boilerplate) kod, objašnjava greške i predlaže optimizacije. No, prava revolucija umjetne inteligencije nije u tome kako pišemo kod, već u tome kako čitamo svijet. Tradicionalna analiza sadržaja desetljećima je uspješno funkcionirala na reprezentativnim uzorcima medija i medijskih objava. Istraživači su bez problema tumačili kontekst, sarkazam i metafore u stotinama članaka ili poruka. Međutim, ta metodologija nailazi na ograničenje s pojavom digitalne hiperprodukcije sadržaja. Ljudi mogu kvalitetno obraditi stotine jedinica, ali ne mogu pročitati milijune tweetova ili tisuće zakonskih akata koji nastaju svakodnevno. AI ovdje ne ispravlja lošu metodu, već rješava problem skalabilnosti. LLM-ovi omogućuju da se ona ista kvalitativna dubina i nijansirano razumijevanje, koje je bilo svojstveno za tradicionalnu analizu sadržaja, sada preslika na cijelu populaciju podataka. To nam omogućuje da pretvorimo relacijski nered interneta u strukturirane, mjerljive varijable, zadržavajući pritom bogatstvo značenja koje se prije gubilo u velikim brojevima.

Kako dalje?

U tom novom poretku događa se fascinantna inverzija vrijednosti. Što strojevi postaju inteligentniji, to ljudska intuicija postaje dragocjenija. AI, preuzimajući na sebe teret kognitivnog rudarenja (pisanje koda, čišćenje podataka i inicijalnu sintezu) ne čini stručnjaka suvišnim, već ga oslobađa za više razine Bloomove taksonomije, evaluaciju, kreativnost i stratešku prosudbu. AI spušta ljestvicu za tehničke vještine, ali podiže strop intelektualnog dometa. U svijetu u kojem je generiranje odgovora postalo jeftino (?!) i trenutačno, valuta postaje sposobnost postavljanja pravog pitanja. Istraživač budućnosti tako prestaje biti tek manualac u rudniku podataka i postaje arhitekt značenja. Njegova se vrijednost više ne mjeri sposobnošću da pamti sintaksu, već mudrošću da u moru sintetičke inteligencije prepozna, validira i kontekstualizira ljudski vrijedne istine. To nije kraj društvenih znanosti kakve poznajemo, već njihov povratak korijenima, samo što sada, umjesto povećala, u rukama držimo teleskop.

[1] https://sociologija.hr/evolucija-statistickih-metoda-u-drustvenim-znanostima-od-deskriptivne-statistike-do-racunalne-inteligencije-i-dio/

[2] https://www.nature.com/articles/s44271-023-00003-2

Ovaj tekst je sufinanciran sredstvima Fonda za poticanje pluralizma i raznovrsnosti elektroničkih medija.

Autor

-

View all posts

View all postsLuka Šikić predaje grupu kvantitativnih i metodoloških kolegija poput Uvoda u Statistiku, Primijenjene statistike, Data Science for Social Sciences, Obrade prirodnog jezika, Multivarijatne statistike, Analitike društvenih mreža, Novih medija i web tehnologija i dr. Studirao je ekonomiju i financije na raznim međunarodnim sveučilištima i Ekonomskom fakultetu u Zagrebu, gdje je stekao titulu doktora znanost. Od 2012. do 2020. godine radio je kao istraživač u Institutu Ivo Pilar, zatim od 2020. do 2023. godine kao postdoktorski istraživač na Fakultetu hrvatskih studija, a od 2023. godine izabran je u zvanje docenta na Hrvatskom katoličkom sveučilištu. Paralelno s akademskim radom bavi se samostalnim projektima u području podatkovnih znanosti i algoritamskog trgovanja na financijskim tržištima. Autor je većeg broja znanstvenih radova objavljenih u međunarodnim časopisima.